Votre legacy n’est pas seulement un frein technique. C’est un coût opérationnel qui s’accumule silencieusement. Selon une étude Savanta pour Pegasystems menée auprès de 500 décideurs IT, les grandes entreprises perdent en moyenne 370 millions de dollars par an en raison de leur incapacité à moderniser efficacement leurs systèmes hérités, entre projets échoués, maintenance continue et intégrations fragiles. Moderniser son legacy devient alors un enjeu technique et économique.

Cependant, le problème n’est pas l’envie de changer mais la peur de tout casser. Une architecture monolithique illisible, une dette technique accumulée depuis des années et un turnover qui efface progressivement la mémoire du SI sont trois facteurs qui, combinés, transforment la modernisation en chantier redouté. Ce que l’IA change fondamentalement dans cette équation, c’est la capacité à cartographier ce que plus personne ne comprend en quelques semaines, là où un profil senior aurait mis des mois.

Pourquoi le monolithe devient insoutenable

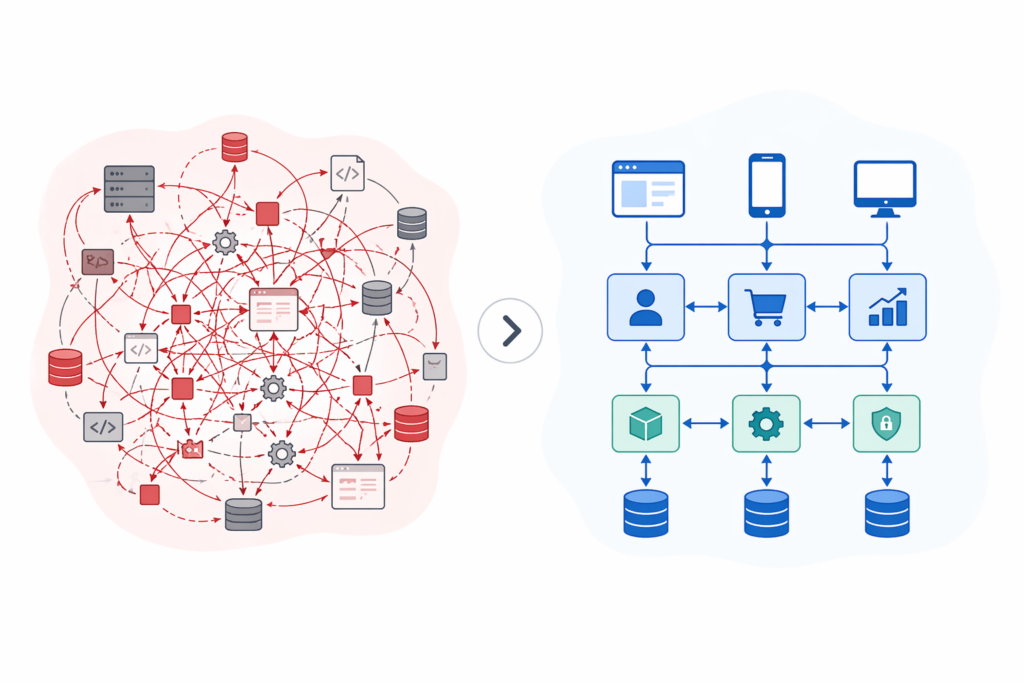

Pendant longtemps, les grandes entreprises ont fait tourner leur SI sur de gros monolithes d’applicatifs, un seul bloc logiciel qui contient tout (logique métier, données, interfaces, intégrations). Ces architectures avaient une logique économique à l’époque, notamment pour des éditeurs qui facturaient leurs licences entre 300 000 et 400 000 euros par an.

Aujourd’hui, cette logique ne tient plus, et c’est précisément ce qui pousse à vouloir moderniser son legacy plutôt que de continuer à le subir. Les entreprises ne veulent plus payer des licences massives pour des systèmes rigides qu’elles ne contrôlent pas. Par conséquent, on observe un mouvement structurel vers des modules applicatifs plus petits, plus ciblés et plus faciles à remplacer.

La dette technique d’applications : quand le code devient illisible

Après des années de développements successifs, le code devient ce que les développeurs appellent du « code spaghetti ». En clair, cela désigne des dépendances croisées dans tous les sens, des fonctions qui en appellent d’autres sans logique apparente et des flux de données impossibles à tracer à l’œil nu.

Intervenir sur ce type de code est un exercice à haut risque. Modifier un composant peut en faire tomber un autre sans qu’on sache ni où ni comment. Cette incertitude génère de la procrastination. Le sujet est urgent, mais l’absence de visibilité sur les risques pousse à le reporter indéfiniment. Selon une étude Stripe et Harris Poll, les développeurs consacrent en moyenne 33% de leur temps à gérer la dette technique, soit un tiers de la capacité productive d’une équipe absorbée par la maintenance plutôt que par la création de valeur.

Le turnover efface la mémoire du SI

À cela s’ajoute un facteur humain souvent sous-estimé. Dans les équipes techniques, le cycle moyen est de trois à cinq ans. Les projets legacy accumulent donc des couches de code dont les auteurs ont quitté l’entreprise depuis longtemps. Personne ne sait pourquoi tel flux a été conçu ainsi, ni ce qu’il traite réellement.

Les entreprises qui ont ce type de projet cherchent souvent un prestataire externe, non pas pour développer de nouvelles fonctionnalités, mais simplement pour comprendre ce qui existe et indiquer comment s’en sortir. C’est précisément là que l’IA change les règles du jeu. Pour aller plus loin sur cette problématique, notre page sur la reprise de code détaille notre approche sur ce type de mission.

Legacy & IA : cartographier les données comme jamais auparavant

L’invisibilité des flux, le cœur du problème

Avant de pouvoir moderniser quoi que ce soit, il faut comprendre comment les données circulent dans le système. Quels composants traitent quelle information en entrée ? Quels flux sont encore actifs, et lesquels sont abandonnés depuis des années mais jamais supprimés ? Quelles dépendances lient tel module à tel autre ?

Auparavant, répondre à ces questions nécessitait un développeur très expérimenté, capable de lire du code complexe et d’en reconstruire mentalement la logique. Ce profil est rare, cher, et met plusieurs semaines avant de pouvoir rendre un premier diagnostic. De plus, les trois quarts des projets legacy contiennent des flux que personne n’a regardés depuis des années, c’est-à-dire des branches entières du code qui tournent en production sans que quiconque sache si elles sont encore utiles.

Impact de l’IA dans la cartographie des données

L’IA (notamment les grands modèles de langage) change radicalement cette phase d’exploration. En analysant le code source, elle est capable de :

- Identifier quels composants traitent l’information en entrée et tracer le chemin complet de chaque donnée à travers le système

- Repérer les flux actifs et les flux morts et donc ceux qui peuvent être abandonnés sans risque

- Visualiser les dépendances entre modules, y compris celles qui ne sont pas documentées

- Signaler les zones à risque c’est-à-dire les composants sur lesquels tout le reste repose sans que cela soit visible dans le code

En pratique, cette capacité à cartographier les données permet de passer de l’obscurité totale à une vue structurée du SI en quelques semaines. Ce qui prenait des mois à un profil senior devient accessible à une équipe projet classique. Le gain de temps observé sur ces phases d’exploration est de l’ordre de 30%.

Ce que l’IA ne remplace pas

L’IA explore les flux et cartographie les dépendances, mais elle ne remplace pas la compréhension métier. Ce sont les experts métiers du client qui valident que le résultat correspond à la réalité opérationnelle. L’IA accélère l’exploration et les humains valident la logique.

C’est l’approche que nous défendons chez Hello Pomelo lors d’un audit applicatif : comprendre d’abord la logique et le métier du client, s’appuyer sur ses experts, puis vérifier que la cartographie reflète ce qu’on attend réellement du système. Une modernisation qui ne reflète pas la réalité opérationnelle ne sert à rien.

De la cartographie au découplage : comment moderniser son legacy sans tout casser

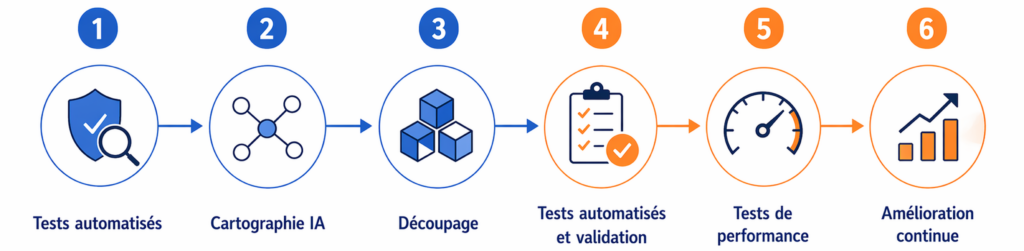

Une fois les flux cartographiés, le vrai travail commence. Il faut sortir les dépendances, découpler les blocs, et moderniser sans rien casser. Voici un exemple de méthodologie concrète sur les projets de reprise code.

Étape 1 : Tests automatisés

La règle fondamentale est de ne jamais modifier un système sans avoir posé des tests avant. La première action est donc de prendre le projet à l’instant T et de mettre en place une couverture de tests (tests unitaires, tests d’intégration, tests end-to-end) qui serviront de filet de sécurité pour toute la suite. Sans cette base, n’importe quelle modification peut casser des comportements existants sans qu’on s’en rende compte. Avec elle, chaque changement est immédiatement validé ou invalidé.

Étape 2 : Cartographier les données avec l’IA

C’est la phase décrite précédemment. On exploite les capacités de l’IA pour cartographier les données, identifier les flux actifs, repérer les dépendances critiques et signaler les zones à risque. Cette cartographie devient la carte de travail pour toutes les étapes suivantes.

Étape 3 : Identification et découplage des dépendances

À partir de la cartographie, on identifie quels blocs peuvent être extraits du monolithe sans compromettre le reste. Petite zone d’action = petite responsabilité = moins de risques si quelque chose casse. Un bloc extrait peut être transformé en micro-application indépendante, déployable, évolutive et remplaçable sans impacter l’ensemble du système. Concrètement, une application qui tourne avec une dizaine de modules peut être découpée pour porter le double de modules indépendants, chacun n’ayant qu’une seule responsabilité. Si l’un tombe, il tombe seul.

Étape 4 : Tests automatisés et validation fonctionnelle

On extrait le bloc, on le transforme en module indépendant, puis on relance l’ensemble des tests automatisés pour vérifier que rien n’a été cassé dans le reste du système. Si les tests passent, on continue. Sinon, on corrige avant d’aller plus loin. Cette rigueur est ce qui distingue une modernisation maîtrisée d’un projet qui dérape en production.

Étape 5 : Tests de performance

Une fois l’intégrité fonctionnelle validée, on lance des tests de performance pour s’assurer que le découplage n’a pas dégradé la vitesse ou la stabilité du SI. Cette étape est souvent négligée et c’est là que certains projets de modernisation échouent en production, malgré des tests fonctionnels concluants. Un dispositif de TMA est nécessaire en aval pour intervenir au moindre problème et apporter les optimisations nécessaires dans le temps.

Migration vers les microservices : la clé vers la modernisation de son legacy

Le découplage progressif décrit ci-dessus s’inscrit dans une tendance architecturale de fond : la migration vers les microservices. Là où le monolithe concentre tout dans un seul bloc, l’architecture microservices distribue les responsabilités en petits modules autonomes, communiquant entre eux via des APIs ou un middleware.

Monolithe vs microservices

| Critère | Architecture monolithique | Architecture microservices |

|---|---|---|

| Structure | Un seul bloc contenant tout | Modules indépendants et communicants |

| Déploiement | Tout redéployer pour changer une partie | Déploiement module par module |

| Risque en cas de panne | Si un composant tombe, tout tombe | Seul le module concerné est impacté |

| Maintenabilité | Difficile sur du « code spaghetti » accumulé | Chaque module a une responsabilité claire |

| Coût | Licences massives, maintenance lourde | Modules ciblés, coût fractionné |

| Évolutivité | Limitée, toute modification est risquée | Haute, on fait évoluer un module sans toucher les autres |

| Onboarding développeurs | Long et difficile sur du code orphelin | Plus rapide, périmètre limité par module |

| Adapté pour | SI stabilisé à court terme | SI évolutif, croissance, agilité |

La migration microservices ne se fait pas en big bang

Vouloir tout reconstruire en une seule fois est l’erreur classique qui met les projets de modernisation en échec. En effet, la bonne approche est progressive. On extrait un module à la fois, on valide, on stabilise, puis on continue. Chaque cycle de cartographie avec l’IA, de découplage et de test fait avancer la modernisation du legacy sans jamais mettre la production en danger. De plus, l’IA accélère désormais considérablement le développement de nouveaux modules applicatifs. Créer un applicatif ciblé et le brancher au SI existant prend bien moins de temps qu’auparavant. En conséquence, la barrière d’entrée pour sortir progressivement du monolithe n’a jamais été aussi basse.

Hello Pomelo vous accompagne pour moderniser votre legacy

Moderniser un legacy complexe n’est plus un projet réservé aux équipes les plus aguerries. Avec la bonne méthode et une utilisation maîtrisée de l’IA pour cartographier ce que plus personne ne comprend, ce chantier devient accessible. Et ce même sans profil senior ultraspécialisé.

Chez Hello Pomelo, nous accompagnons les DSI et CTO dans la reprise de code, l’audit d’applications et la migration vers des architectures modulaires. Si votre legacy est vieillissant et que vous ne savez pas par où commencer, échangeons sur votre projet.